Arm 公司發佈博文爆料,表示為了滿足未來生成式 AI 需求和智能功能,將推出可以加速 AI 工作的可擴展矩陣擴展 2(SME2)技術。

隨著技術發展,流動裝置的生成式 AI 應用不再只是簡單的聊天機器人和虛擬助手,功能越來越強大,已經可以對文本、聲音、圖像和視頻進行數學推理,提取摘要等高級智能功能。這對於裝置的要求也越來越高。

隨著技術發展,流動裝置的生成式 AI 應用不再只是簡單的聊天機器人和虛擬助手,功能越來越強大,已經可以對文本、聲音、圖像和視頻進行數學推理,提取摘要等高級智能功能。這對於裝置的要求也越來越高。

SME 最早出現在 Armv9 架構中,作為一組可選的高級 CPU 架構擴展,專門用於加速矩陣數學運算。2022年SME2 首次亮相,增加了更多的新功能。 Arm 表示,SME2 可以進行實時的流動端推理任務,包含圖片生成、自然語言處理任務等。值得一提的是,開發者無需修改代碼,可以將其集成至現有模型和應用中,十分便捷。

SME 最早出現在 Armv9 架構中,作為一組可選的高級 CPU 架構擴展,專門用於加速矩陣數學運算。2022年SME2 首次亮相,增加了更多的新功能。 Arm 表示,SME2 可以進行實時的流動端推理任務,包含圖片生成、自然語言處理任務等。值得一提的是,開發者無需修改代碼,可以將其集成至現有模型和應用中,十分便捷。

Arm 公佈了一些數據,表示 Google 的 Gemma 3 模型在 SME2 增強的硬件運行時,要比沒有硬件的速度快 6 倍。單個 CPU 核心一秒內便可運行 800 字的文本摘要。(具體測試的CPU型號未知)

公告中最令人關注的莫過於未來 Android 將具備 SME2 硬件能力。要知道目前 SME 主要是提供給伺服器和工作站級處理器,現在 SME2 設計更加擴展,讓其部署在 Laptop、平板電腦,甚至是更小的智能手機上成為可能。

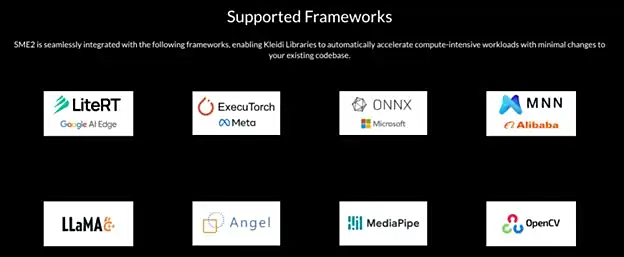

目前 Android 做好支援 SME2,可以在 Google 的 XNNPACK 庫中進行啓用,支援 llama.cpp、阿里巴巴的 MNN 和微軟的 ONNX 等框架。

目前 Android 做好支援 SME2,可以在 Google 的 XNNPACK 庫中進行啓用,支援 llama.cpp、阿里巴巴的 MNN 和微軟的 ONNX 等框架。