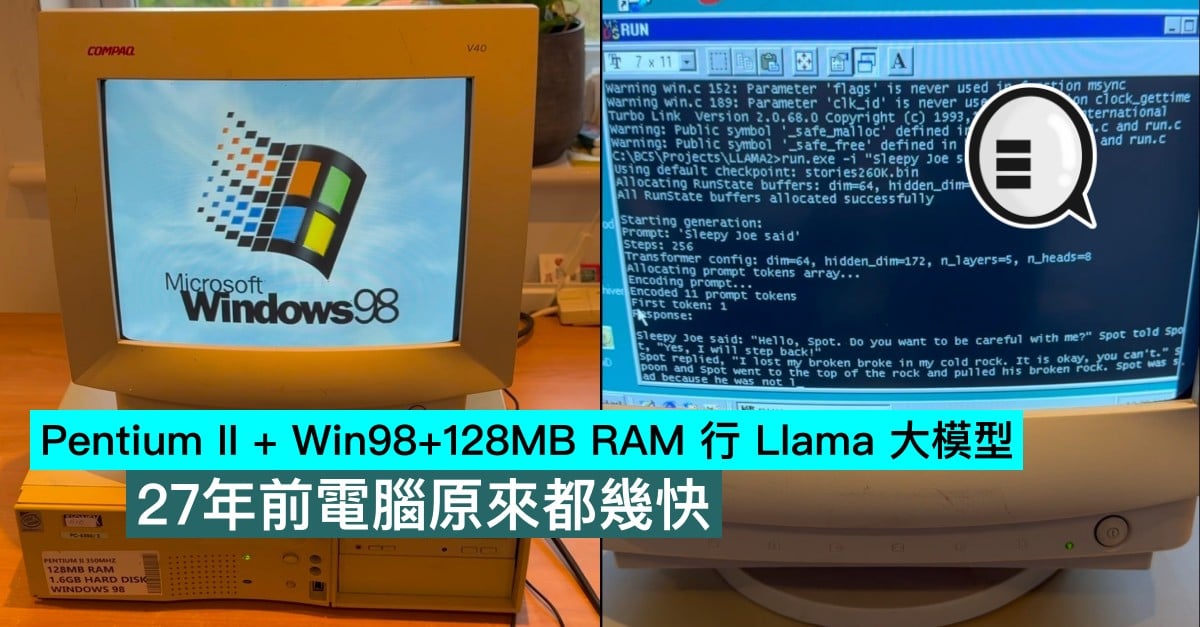

EXO Labs 最近公開了一段影片,內容是在一個擁有 26年歷史的 Windows 98系統、搭載 Pentium II 處理器的電腦上運行大型語言模型(LLM)。這台電腦主頻為 350MHz,成功啓動並進入 Windows 98 操作系統,之後 EXO Labs 啓動了一個基於 Andrej Karpathy 的 Llama2.c 定制的純C語言推理引擎,並要求 LLM 創作一個關於「Sleepy Joe」的故事,故事生成的速度相當快。

EXO Labs 最近公開了一段影片,內容是在一個擁有 26年歷史的 Windows 98系統、搭載 Pentium II 處理器的電腦上運行大型語言模型(LLM)。這台電腦主頻為 350MHz,成功啓動並進入 Windows 98 操作系統,之後 EXO Labs 啓動了一個基於 Andrej Karpathy 的 Llama2.c 定制的純C語言推理引擎,並要求 LLM 創作一個關於「Sleepy Joe」的故事,故事生成的速度相當快。

該組織自詡為「民主化AI」的倡導者,由牛津大學的研究人員和工程師組成,他們認為,如果 AI 被少數大型企業所控制,將對文化、真理以及社會的其他基本方面產生不利影響。因此,EXO Labs 致力於構建開放的基礎設施,訓練前沿的模型,並確保全球各地的任何人都能夠運行這些模型。這次在 Windows 98 系統上展示的 AI 演示,證明瞭即使在資源極為有限的情況下,也能實現的事。

EXO Labs 在其文章中透露了在 Windows 98 系統上運行 Llama 的過程,他們購買了一部舊的 Windows 98 電腦作為項目的基礎,但在此過程中遇到了諸多挑戰。首先是數據的傳輸遷移,他們被迫採用「傳統的FTP」方法,通過舊式機的 LAN 口進行文件傳輸。

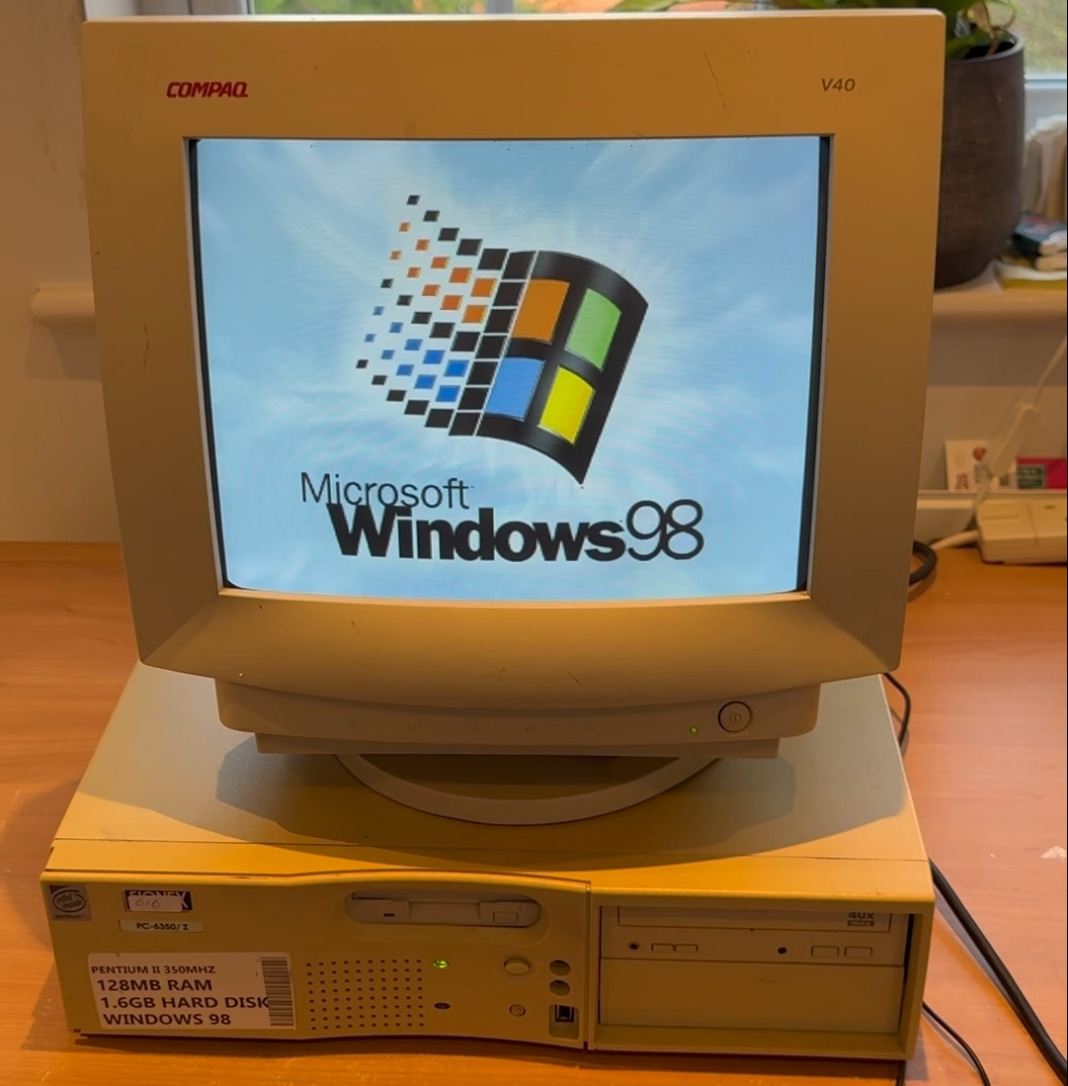

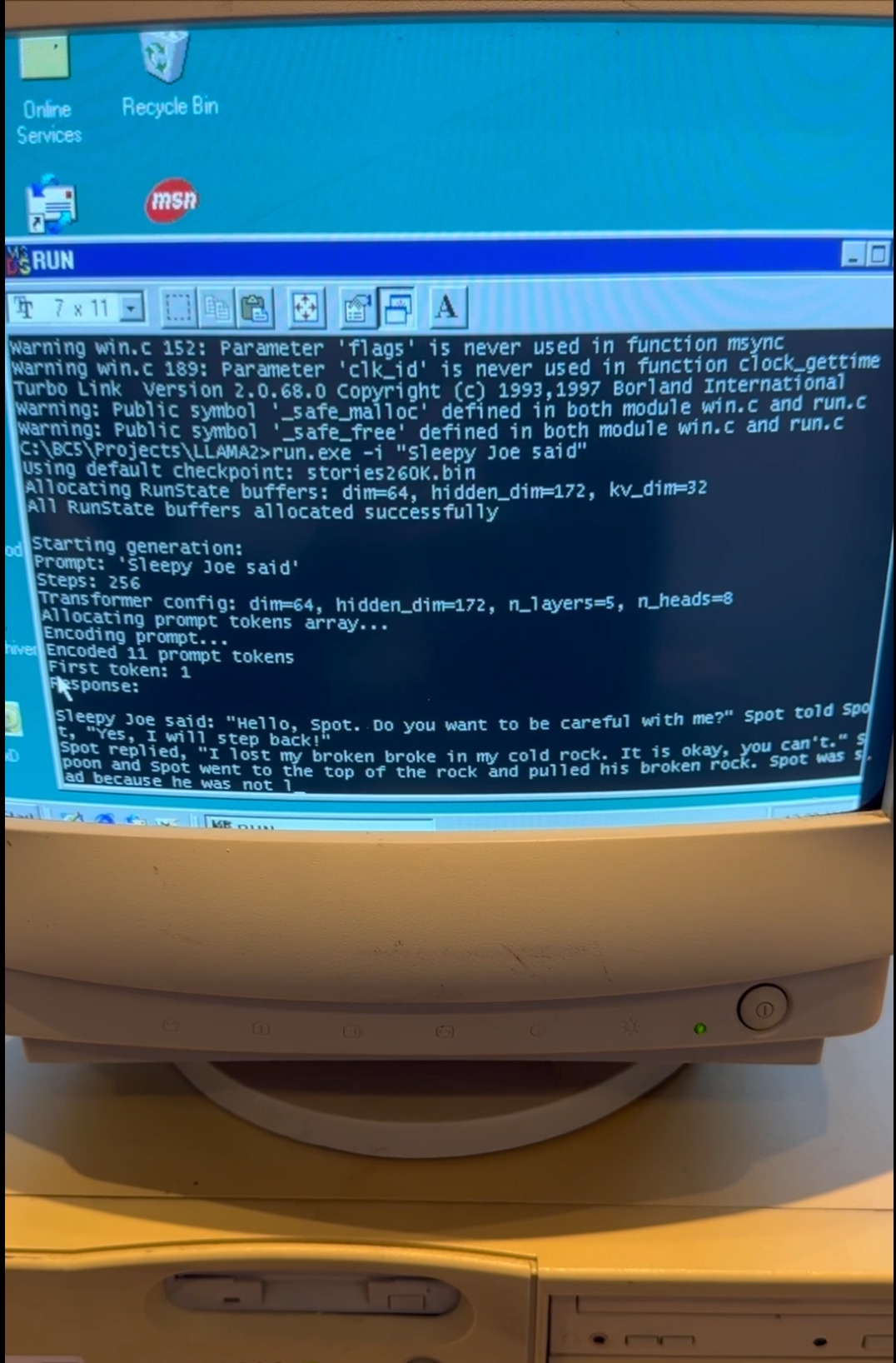

除此之外,編譯現代代碼以適應 Windows 98 系統也是一大難題。EXO Labs 找到了 Andrej Karpathy 的llama2.c,這是一個「700行純C代碼,能夠運行 Llama 2 架構模型的推理」的解決方案。利用這一資源以及舊版的 Borland C++5.02 IDE和編譯器(並進行了一些微調),他們成功地將代碼編譯成 Windows 98 兼容的可執行文件並成功運行,相關代碼可以在 GitHub 上找到鏈接。

除此之外,編譯現代代碼以適應 Windows 98 系統也是一大難題。EXO Labs 找到了 Andrej Karpathy 的llama2.c,這是一個「700行純C代碼,能夠運行 Llama 2 架構模型的推理」的解決方案。利用這一資源以及舊版的 Borland C++5.02 IDE和編譯器(並進行了一些微調),他們成功地將代碼編譯成 Windows 98 兼容的可執行文件並成功運行,相關代碼可以在 GitHub 上找到鏈接。

在 Windows 98 系統上,使用 260K LLM 和 Llama 架構,他們實現了「每秒35.9個token」的速度。根據 EXO Labs 的博客,當升級到 15M LLM 後,生成速度略高於每秒1個 token,而 Llama 3.2 1B 的速度則明顯較慢,為每秒 0.0093個 token。