隨著晶片製程工藝的發展,設備性能越來越強悍,開發者和研究人員在尋找著新的方法利用人工智能和機器學習能力,使其更加實用。

隨著晶片製程工藝的發展,設備性能越來越強悍,開發者和研究人員在尋找著新的方法利用人工智能和機器學習能力,使其更加實用。

Work by @charlietcnash, @joaocarreira, Jacob Walker, Iain Barr, @drew_jaegle, @MateuszOnAI, @PeterWBattaglia 3/3

— DeepMind (@DeepMind) August 15, 2022

在上週,Google DeepMind 科學家宣布創建了一個新框架,名稱為 Transframer。該框架可根據單一的圖像輸入來自動生成短影片。該技術在未來可以增強傳統的渲染解決方案,創建基於機器學習能力的虛擬環境。

Transframer 的名稱是對另一個基於人工智能的模型 Transformer 的致敬。該 Transformer 最初在2017年推出,是創新的新穎神經網絡架構,可通過建模和比較句子中的其他詞來直接生成文本。隨後該模型被納入標準的深度學習框架,例如 TensorFlow 和 PyTorch 等。

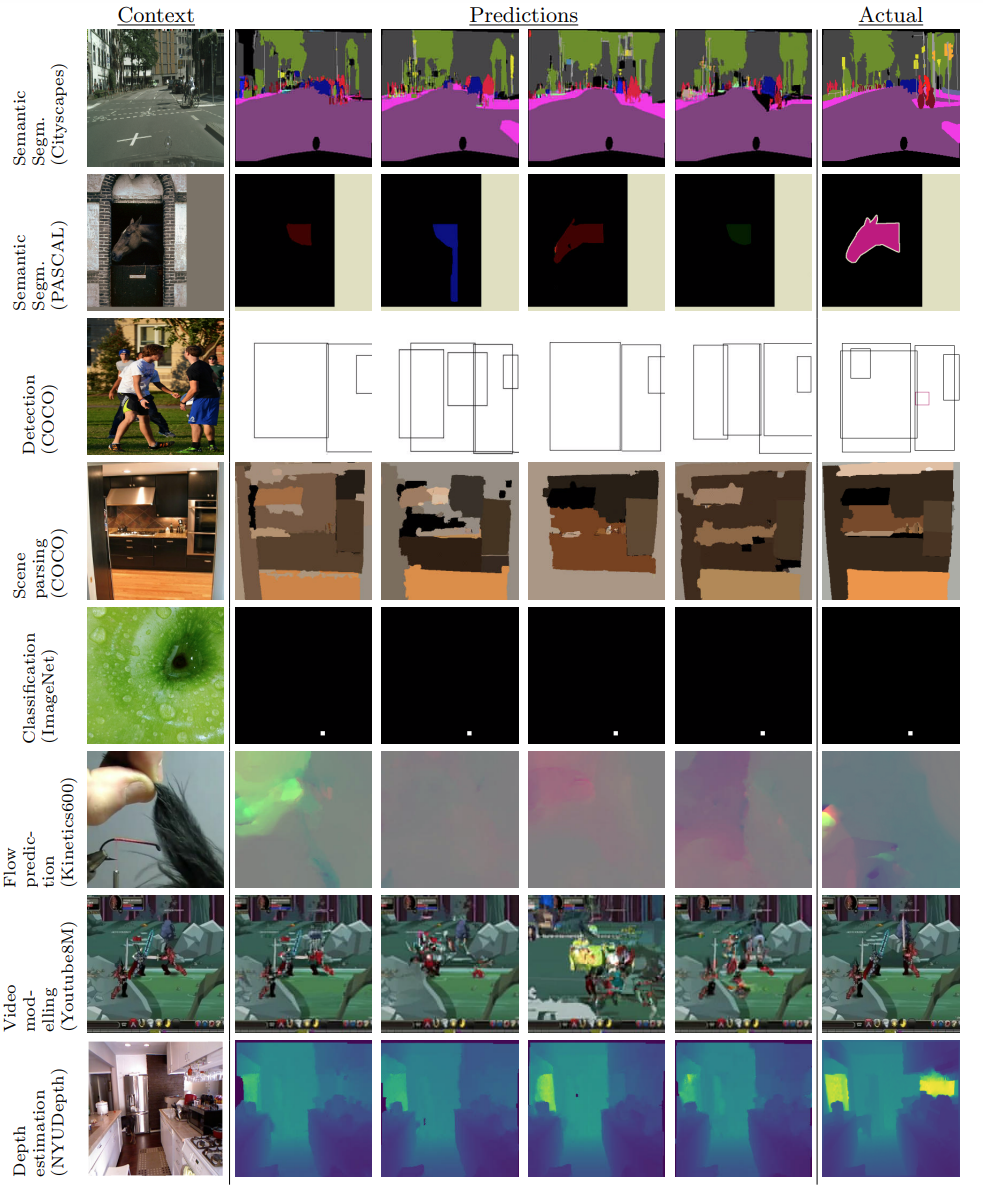

現在 Transframer 更加強悍,可以直接使用具有類似屬性的背景圖像,再結合查詢註釋來創建一段影片。值得一提的是,提供的原始圖像並沒有提供任何幾何數據,但最終生成的影片卻可以在目標圖像周圍移動並將準確進行視角可視化。

官方使用 Google 的 DeepMind 人工智能平台向外進行展示。整個過程是在分析單一的照片背景圖像,從圖片中獲取關鍵的圖像數據,藉此來生成額外的圖像,最終構成一段影片。在這個過程中,系統確定了圖片的框架,幫助識別並預測圖片的周圍環境。

官方使用 Google 的 DeepMind 人工智能平台向外進行展示。整個過程是在分析單一的照片背景圖像,從圖片中獲取關鍵的圖像數據,藉此來生成額外的圖像,最終構成一段影片。在這個過程中,系統確定了圖片的框架,幫助識別並預測圖片的周圍環境。

語境識別用於預測圖片在其他角度可能出現的情況。根據預測的數據來建設額外圖像框架的模型。

雖然目前新框架還不夠成熟,但這憑藉非常有限的數據集生成合理準確的影片能力具有廣闊的市場,標誌影片技術的巨大進步。可提供語義分割、圖像分類和光流預測等功能。

對於基於影片的行業如遊戲開發有著十分深遠的影響。像是目前遊戲依賴十分依賴渲染技術,但通過 Transframer 的構建,可大大減少開發者所需付出的時間、資源和精力。

對於基於影片的行業如遊戲開發有著十分深遠的影響。像是目前遊戲依賴十分依賴渲染技術,但通過 Transframer 的構建,可大大減少開發者所需付出的時間、資源和精力。